Les agents d’IA sont devenus un élément permanent de la prestation de services à la clientèle. Ils répondent aux questions, résolvent les problèmes et, de plus en plus, décident si un client a besoin de parler à un humain.

Pourtant, de nombreuses organisations continuent d’évaluer les performances comme si les humains étaient les seuls agents qui comptent.

Ce décalage se manifeste de manière familière : augmentation des temps de traitement, baisse du sentiment et scores d’assurance qualité qui ne semblent plus refléter l’expérience réelle du client. Le problème n’est pas que les agents humains ne sont pas assez performants. C’est que les agents d’IA façonnent les résultats des clients plus tôt dans le parcours, avant que ces interactions ne tombent dans le champ d’application de la gestion traditionnelle de la qualité

Le temps de manipulation n’est plus une mesure réservée aux humains

L’IA est souvent présentée comme une promesse d’efficacité. Les contacts simples sont censés être résolus automatiquement, ce qui permet aux humains de se concentrer sur des tâches à plus forte valeur ajoutée. Dans la pratique, de nombreuses organisations constatent l’effet inverse une fois que l’automatisation prend de l’ampleur.

Quand les agents virtuels comprennent mal l’intentionretardent l’escalade ou transmettent un contexte incomplet à un humain, l’interaction devient plus difficile, et non plus facile.

Les clients se répètent. Les émotions sont déjà à fleur de peau. L’agent humain hérite d’un problème plus complexe qu’il n’aurait dû l’être. le temps de manipulation augmente en conséquence.

Du point de vue des rapports, cela ressemble à un problème de productivité humaine. En réalité, il s’agit d’un problème d’automatisation en amont que les mesures traditionnelles ne parviennent pas à mettre en évidence.

Le sentiment est établi avant l’arrivée de l’homme

Le sentiment du client ne part pas de zéro lorsqu’une interaction est transférée. Au moment où un agent humain lui dit bonjour, le client peut déjà être frustré par un bot qui tourne en boucle, une tentative de self-service qui a échoué ou une escalade malencontreuse.

Si analyse des sentiments ne s’intéresse qu’à la partie humaine de l’interaction, les organisations se trompent systématiquement sur la cause de l’insatisfaction. Les agents semblent être à l’origine d’un sentiment négatif alors qu’en fait, ils l’absorbent.

C’est la raison pour laquelle de nombreux responsables CX ont du mal à concilier la baisse des scores de sentiment avec un fort d’accompagnement des agents et l’adhésion. Le ton émotionnel de l’interaction a été façonné plus tôt, en dehors du champ d’application de la plupart des programmes de qualité.

Les programmes d’assurance qualité n’évaluent que la moitié du chemin parcouru

Gestion de la qualité s’est toujours concentrée sur le comportement humain : empathie, conformité, résolution et tonalité. Dans le cas d’une main-d’œuvre hybride, ce modèle s’effondre.

Lorsque les agents virtuels sont mesurés à l’aide d’outils distincts, ou ne sont pas mesurés du tout, les équipes d’assurance qualité perdent toute visibilité sur la première moitié du parcours du client. Les agents humains sont alors évalués sur des résultats qu’ils n’ont pas entièrement contrôlés, tandis que l’automatisation fonctionne entièrement en dehors du cadre de qualité.

Au fil du temps, cela érode la confiance dans les scores d’AQ en tant qu’indicateur fiable du CX. Les dirigeants sentent qu’il manque quelque chose, mais ils ont du mal à le formuler.

L’importance d’une couche d’intelligence unifiée

La question centrale est d’ordre structurel. La plupart des entreprises exploitent des environnements multifournisseurs, combinant des plateformes CCaaS avec des agents CRM, ITSM et des agents spécialisés dans l’IA. Chaque plateforme fournit ses propres analyses, mais aucune n’offre une vision neutre et de bout en bout de la manière dont les humains et l’IA fonctionnent ensemble.

C’est le fossé Intelligence omni agentlivré dans le cadre de Calabrio ONEest conçue pour combler cette lacune.

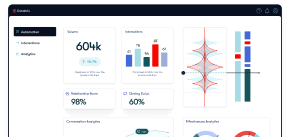

Plutôt que de traiter l’analyse de l’IA comme un canal secondaire, l’Omni Agent Intelligence intègre les agents humains et virtuels dans le même modèle de qualité et d’intelligence. Le temps de traitement, le sentiment et les scores d’assurance qualité sont évalués sur l’ensemble du parcours – du robot à l’humain, en utilisant des définitions et une gouvernance cohérentes.

La valeur de cette approche ne réside pas dans de meilleurs tableaux de bord, mais dans de meilleures décisions. Les dirigeants peuvent voir où l’automatisation réduit réellement les efforts, où elle crée des retouches en aval, et comment le comportement des agents virtuels influe sur les performances humaines et les résultats pour les clients.

Un changement dans la manière de gouverner les performances

À mesure que les agents d’IA deviennent un élément permanent de la prestation de services, les organisations sont confrontées à un choix. Ils peuvent continuer à optimiser les humains de manière isolée ou faire évoluer la gestion de la qualité pour en faire un point de contrôle pour l’ensemble de l’entreprise. la main-d’œuvre hybride.

Ce changement exige de considérer l’automatisation non pas comme un système distinct à surveiller, mais comme un élément du même programme de qualité que celui qui régit les performances humaines.

En effet, dans le service client moderne, le temps de traitement, le sentiment et les scores d’assurance qualité ne sont plus l’apanage des seuls humains, et le fait de les mesurer de cette manière garantit des angles morts.

Alors que les agents d’IA deviennent une partie permanente de la prestation de services, les organisations qui réussiront seront celles qui gouvernent les humains et l’automatisation ensemble, et non dans des tableaux de bord distincts.

Découvrez comment les grandes entreprises utilisent une couche unifiée de qualité et d’intelligence pour comprendre le parcours complet du client, de l’agent virtuel à l’humain et au-delà. Réservez une démonstration dès aujourd’hui!